Databricks¶

Databricksコネクターを使用することで、AzureまたはAWS上のDatabricksのデータにアクセスできます。 Databricksコネクターを使用すると、Databricksテーブルへのアクセスに加え、Delta LakeおよびIceberg形式で保存されたデータへのアクセスが可能です。ただし、それらのデータがDatabricks Unity Catalogにテーブルとして登録されている場合に限ります。 ネイティブDatabricksコネクターは、Databricks Unity Catalogボリュームからの非構造化データの取込みもサポートしており、ベクターデータベースの作成時にボリュームに保存されているファイルを参照して取り込むことができます。

備考

Databricksから構造化データと非構造化データの両方を取り込むには、コネクターを2回追加する必要があります。

Databricksとの接続における相違点

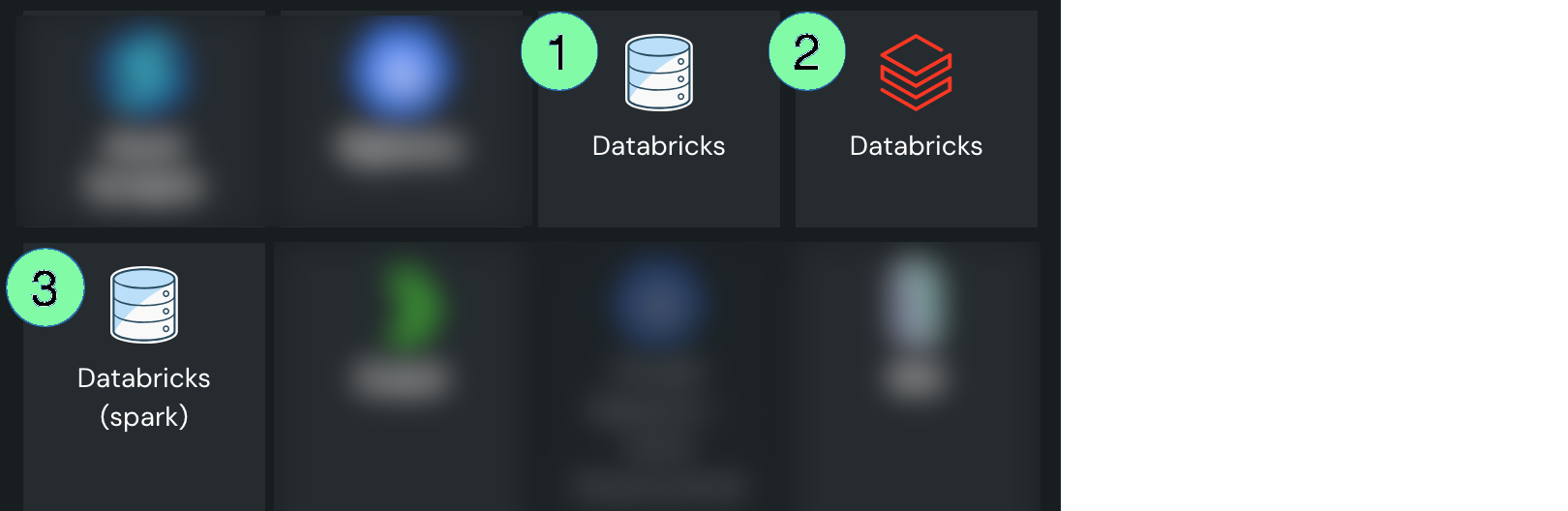

DataRobotでDatabricksに接続する場合、選択できるオプションは3つあります。2つのJDBCドライバーとネイティブコネクターです。

DataRobotではネイティブコネクターの使用を推奨していますが、選択を行う前に以下の表を確認してください。

| 接続タイプ | 説明 | 最適な用途 | サポートされていません | |

|---|---|---|---|---|

| 1 | JDBCドライバー | Databricksバージョン2.6.40で認定されたJDBCドライバー。 | リモートデータベースへの予測の書き戻し | ワークベンチでのデータの操作 |

| 2 | コネクター | ネイティブコネクターと、Databricksとの接続に推奨される方法。 | リモートデータベースの参照、データの取込み、データの準備、ワークベンチでのデータの操作、およびDatabricksボリュームからの非構造化データの取込み。 | 予測の書き戻し |

| 3 | JDBCドライバー | Databricksバージョン2.6.22で最後に認定された古いJDBCドライバー。 | リモートデータベースへの予測の書き戻し | ワークベンチでのデータの操作 |

サポートされている認証¶

前提条件¶

DataRobotでDatabricksに接続する前に、サポートされている認証方法のいずれかに加えて、以下が必要となります。

- Azure Portalアプリの Databricksワークスペース

- Azure Databricksデータベースに保存されたデータ

- AWSの Databricksワークスペース

- AWS Databricksデータベースに保存されたデータ

非構造化データを取り込むには、Databricks Unity Catalogでボリュームを設定する必要もあります。

パーソナルアクセストークンの生成¶

Azure Portalアプリで、Databricksワークスペースのパーソナルアクセストークンを生成します。 このトークンは、DataRobotのDatabricksへの接続の認証に使用されます。

詳細については、Azure Databricksドキュメントを参照してください。

AWSで、Databricksワークスペースのパーソナルアクセストークンを生成します。 このトークンは、DataRobotのDatabricksへの接続の認証に使用されます。

AWSでのDatabricksドキュメントを参照してください。

サービスプリンシパルの作成¶

Azure Portalアプリで、Databricksワークスペースのサービスプリンシパルを作成します。 結果のクライアントIDとクライアントシークレットを使用して、DataRobotで、Databricksへの接続を認証します。

詳細については、Azure Databricksドキュメントを参照してください。 リンクされた手順で、次の情報をコピーします。

- アプリケーションID:DataRobotのセットアップ時に「クライアントID」フィールドに入力します。

- OAuthシークレット:DataRobotのセットアップ時に「クライアントシークレット」フィールドに入力します。

使用するデータにアクセスする権限が、サービスプリンシパルにあることを確認してください。

AWSで、Databricksワークスペースのサービスプリンシパルを作成します。 結果のクライアントIDとクライアントシークレットを使用して、DataRobotで、Databricksへの接続を認証します。

AWSでのDatabricksドキュメントを参照してください。

使用するデータにアクセスする権限が、サービスプリンシパルにあることを確認してください。

Azureサービスプリンシパルの資格情報を生成する¶

Azureサービスプリンシパルの資格情報を生成するには、SharePointのドキュメントに記載されている以下の手順を実行します。

クライアントシークレットを設定したら、以下のセクションに進みます。Databricksでは、Sites.Selected/Sites.Read.All/Files.Read.Allの権限は必要ありません。

サービスプリンシパルのアクセス権を割り当てる¶

サービスプリンシパルのアクセス権を割り当てるには:

- Databricksワークスペースで、Workspace settings > Identity and accessに移動します。

- Service principalsの下にあるAdd service principalをクリックします。

- Azureでアプリケーションを作成する手順で生成された情報を使用して、各フィールドに入力します。

DataRobotでの接続の設定¶

以下の例では、Azureとアクセストークンを使用してDatabricksに接続し、構造化データを取り込む方法を紹介します。

DataRobotで Databricksに接続するには:

- ワークベンチを開き、ユースケースを選択します。

- データソースに接続する手順に従ってください。

-

前のセクションで取得した情報を使用して、 必要な設定パラメーターを入力します。

-

認証で、新しい資格情報をクリックします。 次に、アクセストークンと一意の表示名を入力します。 このデータソースへの資格情報をすでに追加している場合は、保存済みの資格情報から資格情報を選択できます。

認証方法としてサービスプリンシパルを選択した場合、クライアントID、クライアントシークレット、一意の表示名を入力します。

-

保存をクリックします。

必須パラメーター¶

以下の表は、Databricksとの接続を確立するために最低限必要なフィールドの一覧です。

| 必須フィールド | 説明 | ドキュメンテーション |

|---|---|---|

| サーバーのホスト名 | 接続先のサーバーのアドレス。 | Azure Databricksドキュメント |

| HTTP Path | コンピューティングリソースのURL。 | Azure Databricksドキュメント |

| 必須フィールド | 説明 | ドキュメンテーション |

|---|---|---|

| サーバーのホスト名 | 接続先のサーバーのアドレス。 | AWSでのDatabricksドキュメント |

| HTTP Path | コンピューティングリソースのURL。 | AWSでのDatabricksドキュメント |

SQLウェアハウスはSQLの実行専用であるため、その結果としてクラスターよりもオーバーヘッドが少なく、多くの場合はパフォーマンスが向上します。 可能な場合は、SQLウェアハウスを使用することをお勧めします。

備考

接続設定でcatalogパラメーターが指定されている場合、ワークベンチにはそのカタログのスキーマのリストのみが表示されます。 このパラメーターを指定しないと、アクセスできるすべてのカタログがワークベンチに一覧表示されます。

トラブルシューティング¶

| 問題 | 解決方法 | 説明 |

|---|---|---|

| DataRobotで操作を実行しようとすると、ファイアウォールが毎回IPアドレスをクリアするよう要求します。 | DataRobotで許可されたすべてのIPを追加します。 | 許可された送信元IPアドレスを参照してください。 許可されたIPをすでに追加している場合は、既存のIPが完全であることを確認してください。 |

機能に関する注意事項¶

Databricksに接続する前に、以下の機能に関する注意事項を確認してください。

- 非構造化データはベクターデータベースの作成時のみ使用できます。